内容简介

徒步、登山、露营、溯溪,乃至攀岩、攀冰、潜水、探洞、速降等户外活动在现代社会日益蓬勃发展。然而,人们与自然亲密接触时常常给环境造成破坏,甚至给自己和同伴带来危险。

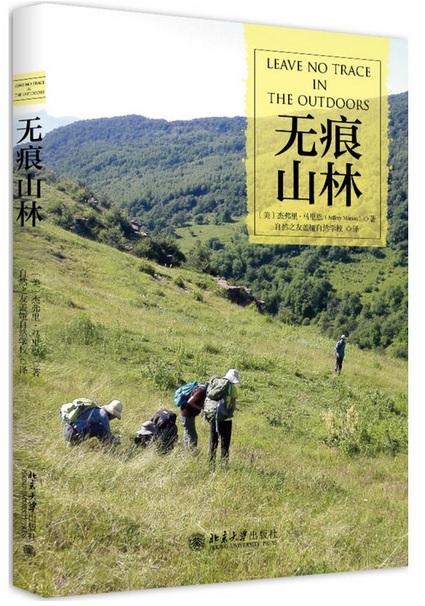

针对这种现象,本书提倡一种"无痕山林"的户外伦理,主张人们在亲近自然、享受美好的时候,采用正确的行为方式,尊重自然中的一切生命,**限度地减少对环境的冲击,进而归纳出了公民户外活动的七大行为准则,每一条都有详细的、可操作的指引。

《无痕山林》图文俱美,既是美国环保界阐述公民户外伦理的经典之作,也是"自然之友"等国内环保组织普及"无痕山林"准则的教材。

针对这种现象,本书提倡一种"无痕山林"的户外伦理,主张人们在亲近自然、享受美好的时候,采用正确的行为方式,尊重自然中的一切生命,**限度地减少对环境的冲击,进而归纳出了公民户外活动的七大行为准则,每一条都有详细的、可操作的指引。

《无痕山林》图文俱美,既是美国环保界阐述公民户外伦理的经典之作,也是"自然之友"等国内环保组织普及"无痕山林"准则的教材。